PDA

@arkatPDA

Followers

848

Following

48K

Media

612

Statuses

11K

Founder @ stealth Mode Startup. ex CTO & Co founder de @tuquejasuma

Córdoba, Argentina (CBA)

Joined March 2008

#CONICET vuelve a ser tendencia. Aprovecho para recordarles que el gobierno decidió eliminar la principal vía de financiamiento de la ciencia básica, que perdimos el 40% de nuestros salarios en 2 años, 800 investigadorxs esperan su ingreso al organismo y la lista sigue...

21

946

3K

Por si no se enteraron, la ciencia argentina está en terapia intensiva, agonizando. Quizás parezca un problema menor, pero es una tragedia a corto, mediano y largo plazo. No tengo palabras para describir la impotencia, la desesperación y la tristeza que siento.

33

733

3K

La última cachetada en contra de la ciencia argentina: la @agenciaidiar elimina los llamados PICT 2022 y 2023 y propone un mamarracho a todas luces insuficiente. Acá miembros del directorio de @Conicet expresan su rotundo rechazo. Y todos los investigadores del sistema, también.

Cinco miembros del Directorio del CONICET se pronuncian contra la política del gobierno expresada en la Agencia Nacional de Promoción de la Investigación, el Desarrollo Tecnológico y la Innovación 👇🏼

17

331

767

Este 2025, el Congreso sancionó solamente once leyes. El nivel más bajo en diez años. Tres de ellas, veladas e insistidas, fueron directamente ignoradas por el PEN. Nadie se escandaliza. Simplemente sucede.

59

1K

4K

Netflix had enough cash to buy Warner Bros., but cried poor when we shared passwords with our mom.

2K

66K

595K

#Cientificidio Un paso más hacia el precipicio. Anularon las convocatorias de proyectos 2022 (que ya se habían adjudicado) y cerraron definitivamente la convocatoria 2023. La Argentina será el único país de toda América que no invierte en ciencia. Aberrante.

118

2K

5K

One of you AI companies better buy us next or I'm going to make a bunch of breaking changes and invalidate all of the code you generate.

331

393

10K

Ohhh, miren miren! Top-notch CS @famaf_unc Estudiá Ciencias de la Computación en la Universidad 🔝 del tema.

2

10

35

Algo increíblemente bueno de los LLMs es que la mayoría de los mails que me llegan están bien escritos.

0

0

0

Gemini Nano Banana Pro can solve exam questions *in* the exam page image. With doodles, diagrams, all that. ChatGPT thinks these solutions are all correct except Se_2P_2 should be "diselenium diphosphide" and a spelling mistake (should be "thiocyanic acid" not "thoicyanic") :O

332

977

9K

New paper drop! 🎙️ We beat GPT-5 with a 36B model 🤯🤯 Not just better in terms of completing real-world complex tasks: software engineering (locating code) and deep research. But also substantially better in terms of proactively asking for clarifying questions when necessary

AI agents are supposed to collaborate with us to solve real-world problems, but can they really? Even the most advanced models can still give us frustrating moments when working with them deeply. We argue that real-world deployment requires more than productivity (e.g., task

34

117

904

Tiny Recursive Models: A tiny 7M parameter model that recursively refines its answer beats LLMs 100x larger on hard puzzles like ARC-AGI We independently reproduced the paper, corroborated results, and released the weights + API access for those looking to benchmark it 🔍

23

113

801

on the brink of failure

Opinion: President Javier Milei is not the first leader to try to pull Argentina out of its long-term economic decline. Moreover, just like his many predecessors in this role, he now finds himself on the brink of failure. https://t.co/65SUmvdGg0

0

0

0

I quite like the new DeepSeek-OCR paper. It's a good OCR model (maybe a bit worse than dots), and yes data collection etc., but anyway it doesn't matter. The more interesting part for me (esp as a computer vision at heart who is temporarily masquerading as a natural language

🚀 DeepSeek-OCR — the new frontier of OCR from @deepseek_ai , exploring optical context compression for LLMs, is running blazingly fast on vLLM ⚡ (~2500 tokens/s on A100-40G) — powered by vllm==0.8.5 for day-0 model support. 🧠 Compresses visual contexts up to 20× while keeping

573

2K

13K

"Generate 5 responses with their corresponding probabilities, sampled from the full distribution:" Just paste this line before any creative task. That's it! Instead of the same "safe" answer five times, you get five completely different ones. Here's the difference:

10

23

337

Excited to release new repo: nanochat! (it's among the most unhinged I've written). Unlike my earlier similar repo nanoGPT which only covered pretraining, nanochat is a minimal, from scratch, full-stack training/inference pipeline of a simple ChatGPT clone in a single,

701

3K

24K

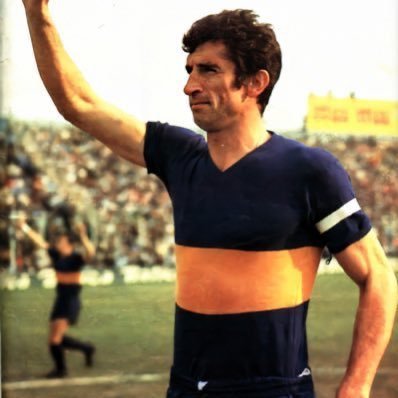

El último deseo de Miguel era volver a dirigir a Boca. Lo confirma, por si hacía falta, su hijo Nacho. Se fue vestido con nuestros colores y jurándole lealtad a la camiseta. Eterno. Pd: gracias, Román.

22

201

2K

Los dos sabían todo, me quiero morir. Solamente le pidió disfrutar y que sea feliz, y asi fue. Te vamos a amar por siempre, Miguel.

117

2K

19K

En tiempos donde imperan los impíos, los que aún conservan la humanidad como bandera, son los que resaltan. Román le dio la posibilidad a Miguel de vivir su pasión hasta el último suspiro. Y aún sabiendo que lo iban a crucificar, no claudicó. Eso es hidalguía.

1

979

6K